La adopción de tecnologías de IA en el espacio universitario no es una opción, es una necesidad. Pero estos sistemas no son herramientas neutrales, sino artefactos sociotécnicos que reproducen las visiones de mundo de sus creadores. En la era de la inteligencia artificial, ¿será la universidad un lugar de reproducción acrítica de lógicas algorítmicas o el último bastión de pensamiento crítico capaz de imaginar un futuro donde la tecnología sirva a fines genuinamente humanos? Frente a esa pregunta, la Universidad de Chile desarrolló la propuesta pedagógica DECIDE-AI.

Por Francisco Sereño | Imagen principal: Cristina Quincler/AFP

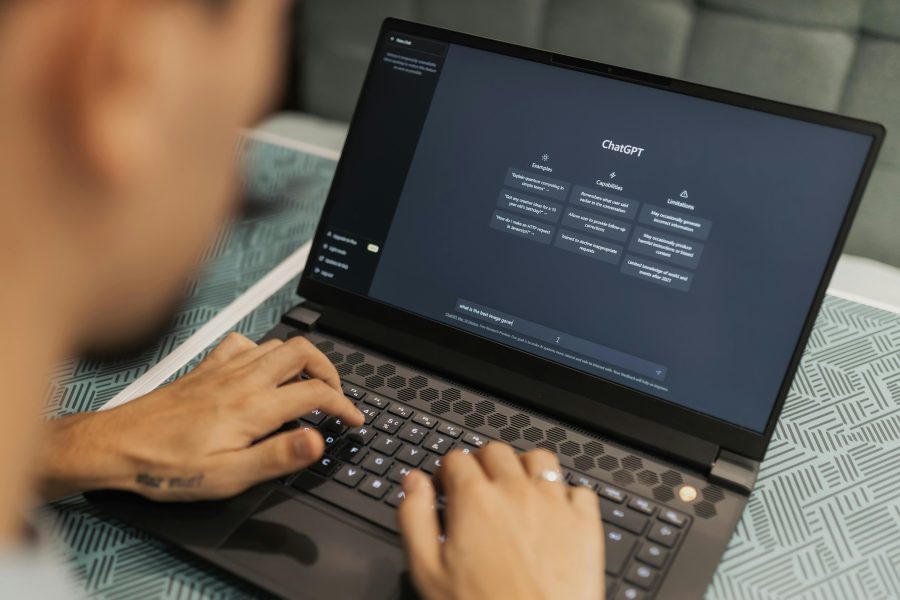

La irrupción de la inteligencia artificial generativa en la educación superior configura un escenario de profundas tensiones epistemológicas, pedagógicas y éticas que desafían los fundamentos del quehacer universitario. La velocidad con que ChatGPT y otras herramientas de este tipo han penetrado el espacio académico revela tanto la porosidad de nuestras instituciones frente a las innovaciones tecnológicas, como la ausencia de marcos reflexivos que orienten su adopción. Este fenómeno, lejos de constituir un proceso neutral, reproduce lógicas de poder y dependencia tecnológica que la universidad debiera interrogar críticamente.

La narrativa dominante presenta la IA como una herramienta democratizadora que promete personalización del aprendizaje, eficiencia evaluativa y acceso expandido al conocimiento. Sin embargo, esta promesa oculta problemas con relación a la naturaleza del aprendizaje, el rol de la universidad y las finalidades de la educación superior. ¿Qué concepciones de conocimiento, sujeto y sociedad subyacen a estos sistemas? ¿Qué voces y perspectivas quedan silenciadas en los corpus de entrenamiento?

Competencias docentes o domesticación digital

Como se mencionó anteriormente, los sistemas de IA no son herramientas neutrales, sino artefactos sociotécnicos que cristalizan y reproducen las visiones de mundo de sus creadores. Los modelos de lenguaje entrenados sobre todo con textos en inglés reproducen sesgos epistemológicos, culturales y políticos que la adopción acrítica naturaliza. La universidad, al integrar estos sistemas sin mediación crítica, arriesga convertirse en agente de colonización epistémica.

La aparente objetividad de las respuestas generadas por la IA oculta los procesos de selección, categorización y jerarquización inherentes a su entrenamiento. Cuando un estudiante recibe una síntesis sobre historia latinoamericana generada por un modelo entrenado principalmente en base a fuentes anglosajonas, ¿qué narrativas se privilegian y cuáles se invisibilizan?

La promesa de aprendizaje personalizado seduce con su aparente alineación con principios de equidad e inclusión. Sin embargo, esta personalización algorítmica encierra paradojas profundas. Por una parte, los sistemas requieren categorizar y etiquetar estudiantes según patrones predefinidos, reproduciendo y potencialmente amplificando estereotipos y expectativas diferenciadas. Por otra, la fragmentación de experiencias educativas erosiona el carácter de la universidad como espacio de encuentro y construcción colectiva de conocimiento.

La verdadera equidad educativa no radica en proporcionar a cada estudiante un camino algorítmicamente optimizado, sino en garantizar acceso a experiencias formativas ricas y diversas que expandan horizontes de posibilidad. La obsesión por la eficiencia adaptativa amenaza con reducir la educación a una transmisión optimizada de información, obviando su dimensión transformadora y emancipatoria.

Los sistemas de evaluación automatizada aseguran eliminar sesgos humanos y garantizar consistencia, pero esta promesa ignora que los criterios de evaluación codificados en algoritmos no son menos subjetivos por estar matematizados. Más preocupante aún, la evaluación algorítmica reduce procesos complejos de aprendizaje a métricas cuantificables, invisibilizando dimensiones cruciales pero difícilmente mensurables: creatividad divergente, pensamiento crítico, sensibilidad ética, capacidad reflexiva. La universidad que delega la evaluación a sistemas de IA arriesga empobrecer su concepción misma de qué significa aprender y conocer.

El marco de competencias en IA para docentes propuesto por UNESCO representa un esfuerzo significativo por sistematizar capacidades necesarias en el nuevo contexto. Sin embargo, una lectura crítica revela tensiones no resueltas y premisas cuestionables.

La estructuración en cinco dimensiones —mentalidad centrada en el ser humano, ética, fundamentos técnicos, pedagogía y desarrollo profesional— sugiere una visión compartimentada que no captura la complejidad del desafío. ¿Puede separarse la dimensión ética de la pedagógica cuando toda decisión educativa es inherentemente valorativa? ¿No reproduce la categorización de “fundamentos técnicos” la falacia de neutralidad tecnológica? ¿No debiera reconocerse como competencia avanzada la capacidad de discernir cuándo no usar IA?

DECIDE-IA: un marco de interrogación crítica

DECIDE-IA constituye una propuesta pedagógica que elaboro bajo el alero de la Vicerrectoría de Tecnologías de la Información de la Universidad de Chile, que emerge como respuesta ante la urgente necesidad de articular un marco reflexivo para la incorporación crítica de tecnologías de inteligencia artificial en los procesos formativos universitarios. Esta propuesta, gestada a partir de una revisión del estado del arte y sistematizando las experiencias acumuladas en las diversas instancias de perfeccionamiento docente implementadas por la vicerrectoría, aspira a superar los enfoques instrumentales que hegemonizan la discusión sobre IA en el ámbito educativo.

El marco DECIDE-IA se configura como un dispositivo heurístico de interrogación crítica que problematiza la incorporación de sistemas de inteligencia artificial desde una perspectiva multidimensional. Su denominación obedece tanto a un acrónimo que condensa las dimensiones analíticas propuestas —Didáctica, Equidad, Crítica, Integridad, Desarrollo y Evidencia— como a un llamado directo a la comunidad universitaria para asumir un rol protagónico y reflexivo frente a las decisiones sobre adopción tecnológica. No se trata, en consecuencia, de un recetario prescriptivo de implementación, sino de una herramienta analítica que busca complejizar la reflexión y orientar procesos de deliberación informada al interior de las comunidades académicas.

La pertinencia de este marco se sustenta en el reconocimiento de que la incorporación de tecnologías de IA en el quehacer universitario no constituye un proceso técnico aséptico, sino una transformación que reconfigura relaciones pedagógicas, epistemológicas y éticas medulares. Frente a la vertiginosa penetración de estas herramientas en las prácticas educativas —muchas veces motorizada por lógicas mercantiles y discursos tecno-optimistas—, DECIDE-IA propone un necesario momento de detención reflexiva que posibilite examinar con rigor las implicancias de estas adopciones para el proyecto formativo de una universidad pública.

El marco se vertebra en torno a seis dimensiones interdependientes, cada una de las cuales plantea interrogantes fundamentales que nuestra comunidad universitaria debiera abordar al momento de considerar la integración de herramientas con IA:

- Dimensión didáctica: la primacía de lo pedagógico

La pregunta fundamental no es qué puede hacer la IA, sino qué debe hacer la educación. Todo análisis debe partir de una reflexión profunda sobre propósitos educativos, concepciones de aprendizaje y modelos de sujeto que buscamos formar. ¿Cómo aseguramos que la herramienta sirva a objetivos pedagógicos y no los defina? ¿Fortalecen o debilitan la relación pedagógica fundante entre docentes y estudiantes? ¿Qué perdemos cuando delegamos procesos formativos a algoritmos? La subordinación de medios tecnológicos a fines pedagógicos constituye un principio irrenunciable que resiste la inversión tecnocrática donde la disponibilidad de herramientas define objetivos educativos.

- Dimensión de equidad: más allá del acceso

La equidad trasciende consideraciones de acceso tecnológico, interrogando cómo los sistemas de IA reconfiguran relaciones de poder y reproducen o desafían estructuras de exclusión. ¿Qué estudiantes se benefician de modalidades algorítmicas de aprendizaje? ¿Qué saberes y formas de conocer privilegian estos sistemas? ¿Cómo operan los sesgos de clase, género y etnia en algoritmos entrenados con datos de otros países? ¿La personalización algorítmica reduce brechas o las naturaliza al adaptar expectativas diferenciadas? ¿Qué voces quedan silenciadas cuando el conocimiento se filtra a través de modelos preentrenados? La verdadera equidad exige examinar no solo quién accede a la tecnología, sino cómo esta reconfigura las posibilidades de ser y conocer.

- Dimensión crítica: condición de posibilidad

El pensamiento crítico no constituye una competencia más a desarrollar sino una condición de posibilidad para una integración no alienante de tecnologías. ¿Cómo cultivar pensamiento crítico cuando las respuestas vienen preelaboradas? ¿Qué sucede con la capacidad de formular preguntas cuando los sistemas proporcionan respuestas instantáneas? ¿Pueden nuestros estudiantes distinguir entre información y conocimiento, entre respuesta y comprensión? ¿Desarrollamos ciudadanos críticos o consumidores pasivos de contenido algorítmico? Los sistemas que proporcionan respuestas sin explicitar sus procesos de construcción obstaculizan este desarrollo crítico, promoviendo el consumo pasivo de información preprocesada.

- Dimensión de integridad: ética como fundamento

La integridad académica en contextos de IA trasciende las preocupaciones sobre plagio, apuntando hacia cuestiones fundamentales sobre la autenticidad del aprendizaje y la honestidad intelectual. ¿Qué significa la autoría cuando el pensamiento emerge de la interacción humano-máquina? ¿Cómo preservar la integridad del proceso formativo cuando atajos tecnológicos prometen resultados sin esfuerzo? ¿Dónde reside el mérito académico en trabajos cocreados con IA? ¿Qué implicancias tiene para la formación del carácter intelectual la disponibilidad permanente de muletas cognitivas? ¿Cómo distinguir entre uso legítimo y suplantación del esfuerzo intelectual?

- Dimensión de desarrollo: sujetos, no usuarios

El desarrollo humano integral constituye un horizonte irrenunciable de la educación universitaria. ¿Formamos sujetos autónomos o dependientes tecnológicos? ¿Qué capacidades humanas atrofiamos al delegar funciones cognitivas a máquinas? ¿Cómo afecta a la formación de identidad profesional la mediación algorítmica del aprendizaje? ¿Qué tipo de profesionales y ciudadanos emergen de aulas algorítmicamente mediadas? Los sistemas de IA deben evaluarse según su contribución a formar sujetos autónomos, críticos y creativos, no usuarios eficientes de tecnologías.

- Dimensión de evidencia: contra el entusiasmo acrítico

La exigencia de evidencia empírica robusta constituye un antídoto necesario contra las narrativas promocionales y las adopciones impulsadas por modas. ¿Qué evidencias sustentan las promesas de mejora educativa? ¿Cómo medimos impactos que trascienden métricas de eficiencia? ¿Quién financia el desarrollo de los algoritmos y qué intereses representan? La evidencia relevante trasciende métricas de eficiencia, requiriendo aproximaciones cualitativas que capturen la complejidad de procesos educativos y efectos no anticipados de mediación tecnológica.

Por una universidad que piensa la técnica

La cuestión de la IA en la educación superior no admite respuestas técnicas a problemas que son fundamentalmente políticos, éticos y pedagógicos. Sin embargo, reconocer la complejidad del desafío no puede traducirse en parálisis institucional. En una era donde la ciudadanía digital es una dimensión ineludible de la participación social y donde los algoritmos median crecientemente nuestras formas de conocer y relacionarnos, la universidad no puede refugiarse en una torre de marfil analógica.

La adopción de tecnologías de IA en el espacio universitario no constituye una opción, sino una necesidad histórica. La pregunta no es si integrar estas herramientas, sino cómo hacerlo preservando la autonomía intelectual y los valores formativos esenciales. Nuestros estudiantes habitarán —ya habitan— mundos profesionales y sociales profundamente mediados por sistemas algorítmicos. Negarles la oportunidad de desarrollar competencias críticas para navegar estos entornos constituiría una forma de exclusión.

DECIDE-IA propone precisamente esto: no una resistencia nostálgica ni una adopción acrítica, sino una apropiación reflexiva y situada. Apropiarse significa hacer propio, transformar según necesidades y valores locales, resistir la imposición de lógicas externas mientras se aprovechan potencialidades genuinas. La universidad debe desarrollar sus propios marcos de comprensión y uso, de acuerdo a su misión pública y compromiso social.

Esta apropiación crítica requiere valentía intelectual para experimentar sin claudicar principios, para innovar sin olvidar tradiciones valiosas, para modernizar sin mercantilizar. Implica formar estudiantes capaces no solo de usar herramientas de IA, sino de comprenderlas, cuestionarlas y, cuando sea necesario, imaginar alternativas. La ciudadanía digital no se reduce a competencias operativas, sino que incluye capacidad de interrogar los sistemas que configuran nuestra realidad.

El verdadero desafío trasciende la integración tecnológica y apunta hacia la redefinición del rol universitario en sociedades algorítmicamente mediadas. Si la universidad renuncia a su función crítica, limitándose a entrenar usuarios competentes de sistemas que no comprenden ni controlan, ¿qué institución asumirá la responsabilidad de pensar los fundamentos y consecuencias de la revolución algorítmica? Si abdicamos a nuestro rol de formar sujetos autónomos capaces de cuestionar lo dado, ¿no estaremos contribuyendo a consolidar nuevas formas de dominación tecnológica?

La pregunta que debe guiar nuestras decisiones no es solo instrumental, sino también filosófica y política: en la era de la inteligencia artificial, ¿será la universidad un espacio de reproducción acrítica de lógicas algorítmicas o el último bastión de pensamiento crítico capaz de imaginar futuros alternativos donde la tecnología sirva a propósitos genuinamente humanos?