El desarrollo acelerado de la inteligencia artificial nos enfrenta a uno de nuestros grandes miedos: que la tecnología nos sustituya. El filósofo Yuk Hui, uno de los principales pensadores de estos asuntos, cree que esta supuesta lucha entre humanos y máquinas es una visión errónea: más que prohibir la IA en las universidades o entrar en pánico, lo que importa es entenderla como una prótesis, como una forma de reforzar el potencial humano.

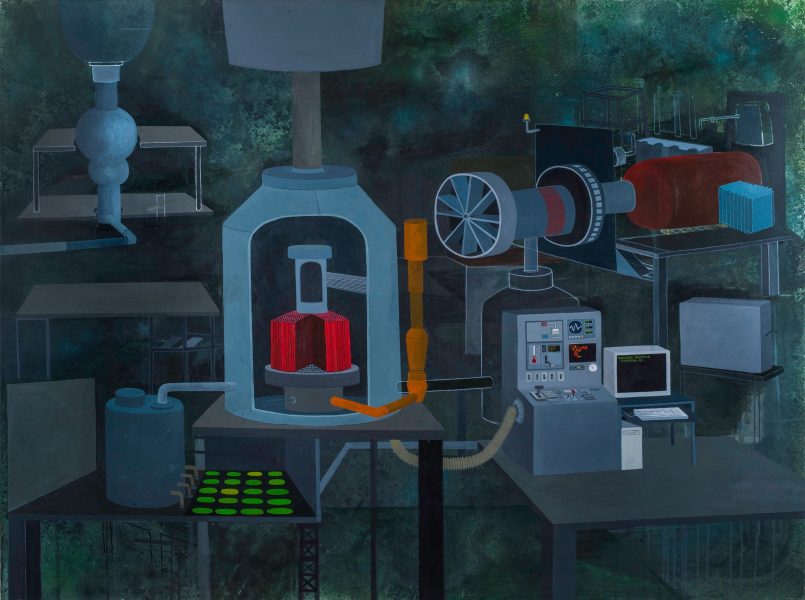

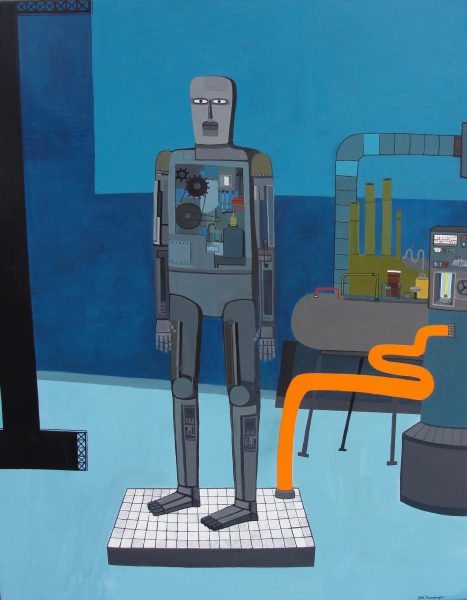

Por Yuk Hui | Imagen principal: José Benmayor. Frankenstein, 2011. 90 x 120 cm

Desde su lanzamiento en noviembre de 2022, el ChatGPT ha despertado entusiasmo y temor. Su aparente dominio de la semántica y la sintaxis —aunque no aún del contenido— de distintos idiomas sorprende a los usuarios que esperaban un chatbot corriente. Algunas universidades prohibieron inmediatamente su uso a los estudiantes para escribir ensayos, ya que supera a la mayoría de ellos. En los diarios, artículos de opinión anunciaron el fin de la educación, no solo porque los estudiantes pueden usarlo para hacer las tareas, sino también porque el ChatGPT puede proporcionar más información que muchos profesores. La inteligencia artificial parece haber conquistado otro dominio que, según la filosofía clásica, define la naturaleza humana: el logos. El pánico crece con esta nueva pérdida de territorio existencial. La imaginación apocalíptica de la historia humana se intensifica a medida que el colapso climático y la rebelión de los robots evocan el fin de los tiempos.

El fin de los tiempos no era una idea ajena a los modernos. De hecho, en el libro El sentido de la historia (1949), de Karl Löwith, el filósofo demostró que la filosofía moderna de la historia, de Hegel a Burckhardt, era una secularización de la escatología1. El telos de la historia es lo que hace inmanente a lo trascendente, ya sea la segunda venida de Jesucristo o simplemente el devenir del Homo deus. Este imaginario bíblico o abrahámico del tiempo ofrece muchas reflexiones profundas sobre la existencia humana en general, pero también dificulta la comprensión de nuestro futuro.

En la década de 1960, Hans Blumenberg argumentó en contra de la tesis de la secularización de Löwith, como también contra la afirmación de Carl Schmitt de que “todos los conceptos significativos de la teoría moderna del Estado son conceptos teológicos secularizados”2. Blumenberg sostenía que la comprensión de lo moderno como secularización o transposición de conceptos teológicos socava la legitimidad de lo moderno; un cierto significado de la modernidad sigue siendo irreductible a la secularización de la teología3. De la misma forma, lo novedoso y significativo de la inteligencia artificial queda sepultado en el imaginario escatológico, por los estereotipos modernos de las máquinas y por la propaganda industrial.

Esto no significa que debamos negar el cambio climático y resistir a la inteligencia artificial. Al contrario, luchar contra el cambio climático debería ser nuestra máxima prioridad, como también lo debería ser desarrollar una relación productiva entre los humanos y la tecnología. Sin embargo, para ello es necesario desarrollar una comprensión adecuada de la inteligencia artificial, más allá de la meramente técnica. La invención del tren, el automóvil y, más tarde, el avión también provocó un gran temor, tanto psicológico como económico, pero hoy pocos temen que estas máquinas se escapen de nuestro control. Por el contrario, los autos y los aviones forman parte de la vida cotidiana y a menudo son sinónimos de emoción y libertad. Entonces, ¿por qué hay tanto miedo frente a la inteligencia artificial?

Para entender esta nueva ola tecnológica que tiene al ChatGPT a la cabeza, podemos empezar con el famoso experimento mental de la habitación china de John Searle, de 1980, que oculta el estereotipo más fastidioso de las máquinas computacionales bajo la apariencia de razonamiento lógico. En este experimento, Searle se imaginaba solo en una habitación, siguiendo instrucciones de un programa de procesamiento de símbolos escrito en inglés para responder a entradas escritas en chino que eran deslizadas por debajo de la puerta. En el experimento, Searle no entiende el chino: “No sé chino, ni escrito ni hablado, y ni siquiera estoy seguro de poder reconocer la escritura china como tal y distinguirla de, digamos, la escritura japonesa o los garabatos sin sentido”4. Sin embargo, argumenta que, con un adecuado conjunto de instrucciones y reglas, podría responder de una manera que haría que la persona afuera de la habitación creyera que entendía chino. En pocas palabras, Searle afirma que el hecho de que una máquina sea capaz de seguir instrucciones en chino no significa que la máquina entienda el chino, una característica distintiva de la llamada IA fuerte (en contraste con la IA débil). Comprender significa, ante todo, comprender la semántica. Mientras que la sintaxis puede codificarse, el significado semántico cambia con la situación y las circunstancias. La habitación china de Searle se aplica a un ordenador que sigue funcionando como una máquina del siglo XVIII, como lo haría el Pato con Aparato Digestivo [el primer robot mascota de la historia] o el Turco Mecánico [un supuesto autómata que jugaba ajedrez]. Sin embargo, este no es el tipo de máquina con el que estamos lidiando hoy. Noam Chomsky, Ian Roberts y Jeffrey Watumull tenían razón al afirmar que el ChatGPT es “un enorme motor estadístico de comparación de patrones”5. No obstante, debemos reconocer que, aunque los patrones son una característica primordial de la información, el ChatGPT hace algo más que comparar patrones.

Dicha crítica sintáctica se basa en una epistemología mecanicista que supone una causalidad lineal: una causa seguida de un efecto. Se puede invertir este proceso de causa y efecto para llegar a la causa última: el motor principal, el origen de la primera causa y el destino último de todo razonamiento lineal. En contraste con la causalidad lineal y la filosofía mecanicista, el siglo XVIII fue testigo del auge del pensamiento filosófico basado en el organicismo, con la Crítica del juicio, de Immanuel Kant, como una de las contribuciones más importantes. Como he afirmado antes, Kant impuso una nueva condición para la filosofía: que esta debía volverse orgánica; es decir, lo orgánico marcó un nuevo comienzo para el pensamiento filosófico6. Hoy es importante reconocer que la forma de filosofar que estableció Kant ha llegado a su fin en la época de la cibernética7.

La cibernética, un término acuñado por Norbert Wiener hacia 1943, fue desarrollada por un grupo de científicos e ingenieros que asistieron a las Conferencias Macy sobre cibernética a finales de los años 40 y principios de los 50. Esta pretendía ser una ciencia universal capaz de unificar todas las disciplinas, una nueva adaptación del enciclopedismo del siglo XVIII, según Gilbert Simondon8. La cibernética utiliza el concepto de retroalimentación para definir el funcionamiento de una nueva “máquina cibernética” distinta de las “máquinas mecánicas” del siglo XVII. Wiener afirmó en su libro pionero de 1948 que la cibernética había superado la oposición entre mecanicismo y vitalismo representada por Newton y Bergson, porque las máquinas cibernéticas se basaban en una nueva forma no lineal de causalidad, o recursividad, en lugar de una causalidad lineal frágil e ineficaz, que no sabe regular su propio modo de funcionamiento. Imaginemos un reloj mecánico: cuando falla uno de sus engranajes, todo el reloj se detiene. Con este tipo de mecanismo lineal, no se puede producir un aumento exponencial de la velocidad del razonamiento sin una actualización radical del hardware.

Si bien la oposición entre mecanismo y organicismo constituye un gran debate de la filosofía moderna, determinando la dirección de su desarrollo, se trata de un debate que persiste hoy, cuando tantas de las sentencias que desacreditan la IA y el ChatGPT asumen que las máquinas son solo mecanicistas y, por tanto, incapaces de comprender el significado semántico. Sería igualmente erróneo afirmar que las máquinas no son más que una imitación fallida del razonamiento humano cuando hablamos del significado semántico. El filósofo y científico cognitivo Brian Cantwell Smith ha criticado duramente este pensamiento antropomórfico, abogando por una intencionalidad maquínica. Según él, aunque no haya intencionalidad humana en una máquina, sigue siendo una forma de intencionalidad; es semántica, aunque no sea en el sentido del lenguaje humano9. Esta separación entre semántica antropomórfica y semántica maquínica es esencial para repensar nuestras relaciones con las máquinas, pero solo como un primer paso.

El argumento de Searle básicamente ignora la forma recursiva de cálculo que realizan las máquinas actuales. Se podría argumentar que la informática no debe confundirse con la cibernética, ya que esta última es una ciencia demasiado amplia. Sin embargo, también se puede pensar en la función recursiva de Gödel y su equivalencia con la máquina de Turing y el cálculo lambda de Alonzo Church (una historia bien conocida en la historia de la computación). El término “recursividad” no solo pertenece a la cibernética, sino también al pensamiento postmecanicista. El advenimiento de la cibernética solo anunció la posibilidad de hacer realidad este razonamiento recursivo de las máquinas cibernéticas.

La “inteligencia” de las máquinas de hoy es una forma reflexiva de funcionamiento, como han observado acertadamente Gotthard Günther y Gilbert Simondon. Para Günther, la cibernética es la materialización de la lógica de Hegel, mientras que para Simondon, fue solo en la Crítica del juicio, en su elaboración sobre el juicio reflexivo, donde Kant abordó la cibernética10. El “pensamiento reflexivo” suele asociarse a los seres humanos y no a las máquinas, porque estas solo ejecutan instrucciones sin reflexionar sobre las propias instrucciones. Pero desde la introducción de la cibernética en los años 40, el término también puede describir el mecanismo de retroalimentación de las máquinas. El pensamiento reflexivo en las máquinas tiene un poder increíble sobre los seres humanos, que no están preparados para aceptar su existencia, incluso entendida como una forma preliminar y básica de reflexión, siendo puramente formal y, por lo tanto, insuficiente para abordar el contenido. En este sentido, podemos entender por qué el ChatGPT puede resultar “poco innovador” y “nada revolucionario” para informáticos como Yann LeCun11. Solo lidiando con el contenido las máquinas podrán avanzar hacia lo que se ha llamado la singularidad tecnológica. Hasta ahora, la singularidad sigue siendo un mito, engañoso y también perjudicial cuando se presenta como un futuro cercano. Incluso si asociamos la singularidad con un significado teológico o escatológico, no aporta nada a la comprensión de la inteligencia artificial o de su futuro.

Las máquinas recursivas, y no las lineales, son clave para entender el desarrollo y la evolución de la inteligencia artificial. ¿Cómo se enfrentarán los humanos a este nuevo tipo de máquinas? Simondon planteó una pregunta similar: cuando la tecnología se vuelva reflexiva, ¿cuál será el papel de la filosofía? Brian Cantwell Smith ha argumentado que la IA se limita a la capacidad de calcular y no de juzgar, pero es difícil saber cuánto tiempo más pueda mantenerse tal distinción12. Quizá se haya perdido demasiado esfuerzo intelectual en hacer distinciones entre máquinas y humanos.

Los seres humanos no se preocuparon cuando animales domesticados, como los caballos y las vacas, los sustituyeron como proveedores de energía. Por el contrario, agradecieron el alivio que les supuso el trabajo repetitivo y agotador. Lo mismo ocurrió cuando las máquinas de vapor reemplazaron a los animales; eran aún más eficientes y requerían aún menos atención humana. Simondon, en su libro de 1958 El modo de existencia de los objetos técnicos, observó acertadamente que la sustitución de las máquinas termodinámicas por máquinas de información marca un momento crítico: el desplazamiento humano del centro de la producción. Antes de la era industrial, los artesanos podían crear un entorno en que el cuerpo y la inteligencia del artesano compensaban la falta de autonomía de sus simples herramientas. En la era de las máquinas de información, o máquinas cibernéticas, la propia máquina se convierte en organizadora de la información y el ser humano deja de estar en el centro, aunque siga considerándose comandante de las máquinas y organizador de la información. Este es el momento en que el humano sufre sus propias creencias estereotipadas sobre las máquinas: se identifica a sí mismo falsamente como el centro y, al hacerlo, se enfrenta a una frustración constante y a una búsqueda desesperada de identidad.

La realidad que habita en la máquina es ajena a la realidad en la que opera el ser humano. El inevitable proceso de evolución tecnológica está impulsado por la introducción de la causalidad no lineal, lo que permite a las máquinas lidiar con la contingencia. Una máquina que aprende es aquella capaz de discernir eventos contingentes, como el ruido y los errores. Puede distinguir las entradas desorganizadas de las necesarias. Y al interpretar los eventos contingentes, la máquina de aprendizaje mejora su modelo de toma de decisiones. Pero incluso en este caso, necesita a los humanos para distinguir las decisiones correctas de las incorrectas para seguir mejorando. En los países en desarrollo, un nuevo tipo de mano de obra barata emplea a humanos para indicar a las máquinas si los resultados son correctos, ya sea en escáneres de reconocimiento facial o en respuestas del ChatGPT. Esta nueva forma de mano de obra, que explota a trabajadores esforzados de forma invisible detrás de las máquinas con las que interactuamos, suele ser pasada por alto en las críticas generales al capitalismo que lamentan una insuficiente automatización. Esta es la debilidad de la crítica marxista actual a la tecnología.

Simondon planteó una cuestión clave en El modo de existencia de los objetos técnicos: cuando el humano deja de ser el organizador de la información, ¿qué papel puede desempeñar? ¿Puede liberarse del trabajo? Como sospechaba Hannah Arendt en La condición humana —publicado el mismo año que el libro de Simondon—, tal liberación solo conduce al consumismo, lo que deja al artista como el “último hombre” capaz de crear13. El consumismo se convierte aquí en el límite de la acción humana. Arendt ve las máquinas desde la perspectiva de la realidad humana, como sustitutas del Homo faber, mientras que Simondon muestra que la incapacidad para tratar e integrar la realidad técnica de las máquinas fomentará un antagonismo desafortunado entre el humano y la máquina, entre la cultura y la técnica. Este antagonismo no solo es fuente de miedo. También se basa en una comprensión muy problemática de la tecnología moldeada por la propaganda industrial y el consumismo. Es a partir de esta negatividad que surgió un humanismo primitivista que identificaba el amor como el último recurso de lo humano.

Han pasado más de 60 años desde que Simondon planteó estas preguntas y aún siguen sin resolverse. Peor aún, han quedado ocultas tanto por el optimismo tecnológico como por el pesimismo cultural, con el primero promoviendo una aceleración implacable y el segundo sirviendo de psicoterapia. Ambas tendencias tienen su origen en una comprensión antropomórfica de las máquinas, que supone que estas deben imitar a los seres humanos (Simondon criticó ferozmente a la cibernética por sostener este punto de vista, aunque no estuviera del todo justificado). Hoy en día, la expresión más irónica de esta visión mimética está en el ámbito del arte, en los intentos de demostrar que una máquina puede hacer el trabajo de un Bach o un Picasso. Por un lado, el humano, presa del pánico, se pregunta una y otra vez qué tipo de trabajos pueden evitar ser sustituidos por máquinas; por otro, la industria tecnológica trabaja conscientemente para sustituir la intervención humana mediante la automatización de las máquinas. Los humanos viven dentro de la profecía autocumplida de sustitución de la industria. Y, de hecho, la industria reproduce constantemente el discurso de la sustitución anunciando el fin de tal o cual trabajo como si hubiera llegado una revolución, mientras que la estructura e imaginario sociales permanecen inalterados.

El discurso de la sustitución no se ha transformado en el discurso de la liberación en las sociedades capitalistas ni en las llamadas comunistas. Para ser justos, algunos aceleracionistas se dan cuenta de esto y han intentado revivir la visión de Marx de la automatización total. Si la física de colegio fuera más popular, tendríamos un concepto más matizado de la aceleración, porque aceleración no significa un aumento de la velocidad [speed, es decir, sin considerar la dirección], sino un aumento de la rapidez [velocity, incluyendo la dirección del movimiento]. En lugar de elaborar una visión del futuro en que la inteligencia artificial cumpla una función protésica, el discurso dominante la trata simplemente como un desafío a la inteligencia humana y una sustitución del trabajo intelectual. Los humanos de hoy no sueñan. Si el sueño de volar condujo a la invención del avión, ahora tenemos pesadillas cada vez más intensas con las máquinas. En última instancia, tanto el tecnooptimismo (en forma de transhumanismo) como el pesimismo cultural se encuentran en su proyección de un final apocalíptico.

La creatividad humana debe tomar una dirección radicalmente distinta y elevar las relaciones hombre-máquina por encima de la teoría económica de la sustitución y las fantasías de interactividad. Debe avanzar hacia un análisis existencial. La naturaleza protésica de la tecnología debe ser reconocida más allá de su funcionalidad, ya que desde el principio de la humanidad el acceso a la verdad siempre ha dependido de la invención y el uso de herramientas. Este hecho sigue siendo invisible para muchos, lo que hace que el conflicto entre la evolución de las máquinas y la existencia humana parezca originarse en una ideología profundamente arraigada en la cultura.

Vivimos en varios bucles de retroalimentación positiva presentados como cultura. Desde el comienzo de la sociedad industrial moderna, el cuerpo humano ha estado subordinado a ritmos repetitivos y, en consecuencia, la mente humana ha sido subsumida por las profecías de la industria. Ya sea el sueño americano o el sueño chino, el enorme potencial humano ha sido suprimido en favor de una ideología consumista. En el pasado, la filosofía se encargaba de limitar la arrogancia producida por las máquinas y de liberar a los sujetos humanos de los bucles de retroalimentación en nombre de la verdad. Hoy en día, los filósofos de la tecnología están ansiosos por afirmar estos bucles de retroalimentación como el camino inevitable de la civilización. El ser humano reconoce ahora la centralidad de la tecnología queriendo resolver todos los problemas como si fueran problemas técnicos. La velocidad y la eficiencia gobiernan toda la sociedad como antes solo gobernaban las disciplinas de ingeniería. El deseo de los educadores de realizar un cambio paradigmático en pocos años desacredita cualquier reflexión fundamental sobre la cuestión de la tecnología, y volvemos a entrar en un bucle de retroalimentación. En consecuencia, las universidades siguen produciendo talento para la industria tecnológica, y este talento pasa a desarrollar algoritmos más eficientes para explotar la privacidad de los usuarios y manipular la forma en que consumen. Para las universidades, debería ser más urgente abordar estas cuestiones que reflexionar sobre la prohibición del ChatGPT.

¿Puede el ser humano escapar de este ciclo de retroalimentación positiva, tan arraigado en la cultura contemporánea, de profecía autocumplida? En 1971, Gregory Bateson describió un ciclo de retroalimentación que atrapa a los alcohólicos: una copa de cerveza no me matará; vale, ya empecé, una segunda estará bien; bueno, ya van dos, ¿por qué no tres? Un alcohólico, si tiene suerte, puede salir de este ciclo de retroalimentación positiva al “tocar fondo”, sobreviviendo a una enfermedad mortal o un accidente automovilístico, por ejemplo14. Esos afortunados supervivientes desarrollan entonces una intimidad con lo divino. ¿Pueden los seres humanos, los alcohólicos modernos, con toda su inteligencia y creatividad colectiva, escapar de este destino de tocar fondo? En otras palabras, ¿puede el ser humano tomar un giro radical y orientar la creatividad en una dirección diferente? ¿No es precisamente esta oportunidad la que brindan las máquinas inteligentes de hoy en día? Como prótesis en lugar de seguidoras de patrones mecánicos, las máquinas pueden liberar al ser humano de la repetición y ayudarnos a fomentar el potencial humano. Cómo adquirir esta capacidad transformadora es, fundamentalmente, nuestra preocupación actual, no el debate sobre si una máquina puede pensar, lo cual es simplemente una expresión de crisis existencial e ilusión trascendental. Tal vez algunas premisas nuevas sobre las relaciones entre humanos y máquinas puedan liberar nuestra imaginación. Aquí hay tres (aunque sin duda se pueden agregar más):

1) En vez de detener el desarrollo de la IA, detengamos la estereotipación antropomórfica de las máquinas y desarrollemos una cultura adecuada de prótesis. La tecnología debería utilizarse para realizar el potencial de sus usuarios (aquí tendremos que entablar un diálogo con la teoría de las capacidades de Amartya Sen) en lugar de ser su competidora o reducirlos a patrones de consumo.

2) En lugar de mitificar las máquinas y la humanidad, comprendamos nuestra realidad técnica actual y su relación con diversas realidades humanas, para que esta realidad técnica pueda integrarse con ellas para mantener y reproducir la biodiversidad, la noodiversidad y la tecnodiversidad15.

3) En vez de repetir la visión apocalíptica de la historia (expresada, en su forma más secular, en el fin de la historia de Kojève y Fukuyama), liberemos la razón de su camino fatal hacia un final apocalíptico. Esta liberación abrirá un campo que nos permitirá experimentar formas éticas de convivencia con las máquinas y otros seres no humanos.

Ninguna invención llega sin obstáculos y problemas. Aunque estos obstáculos son más conceptuales que técnicos, ignorar lo conceptual es precisamente lo que permite que crezca el mal, como resultado de una perversión en la que la forma prevalece sobre el fundamento16. Solo cuando nos liberemos de los estereotipos culturales y de la profecía autocumplida de la industria tecnológica podremos desarrollar una mayor comprensión de las posibilidades del futuro, que no pueden basarse únicamente en el análisis de datos y la extracción de patrones. Es muy probable que, antes de que lleguemos a ese punto, los profetas industriales de nuestro tiempo ya hayan comprendido que las máquinas pueden predecir el futuro mejor que ellos.

Traducción de Evelyn Erlij

Este artículo fue publicado originalmente en E-flux.

- “Esta concepción occidental de la historia, que implica una dirección irreversible hacia un objetivo futuro, no es meramente occidental. Esencialmente, es una suposición hebrea y cristiana de que la historia está dirigida hacia un propósito último y gobernada por la providencia de una visión y voluntad supremas; en términos de Hegel, por el espíritu o la razón como «la esencia absolutamente poderosa».’” Karl Löwith, Meaning in History. University of Chicago Press, 1949, p. 54. ↩︎

- Carl Schmitt, Political Theology: Four Chapters on the Concept of Sovereignty. University of Chicago Press, 2005, p. 36 ↩︎

- Hans Blumenberg, “Progress Exposed as Fate”, en The Legitimacy of the Modern Age. MIT Press, 1985 ↩︎

- John. R. Searle, “Minds, Brains, and Programs,” Behavioral and Brain Sciences 3, nº3 (1980), p. 418 ↩︎

- Noam Chomsky, Ian Roberts, y Jeffrey Watumull, “The False Promise of ChatGPT,” The New York Times, 8 de marzo, 2023 ↩︎

- Yuk Hui, Recursividad y contingencia, Caja Negra, 2022 ↩︎

- Ver Yuk Hui, “Philosophy after Automation,” Philosophy Today 65, nº 2 (2021) ↩︎

- Gilbert Simondon, “Technics Learned by the Child and Technics Thought by the Adult”, en On the Mode of Existence of Technical Objects [1958] (Univocal, 2017) ↩︎

- “Muchas personas han argumentado que la semántica de los sistemas computacionales es intrínsecamente derivada o atribuida, es decir, del tipo que tienen los libros y los signos, en el sentido de ser asignada por observadores externos o usuarios, en contraposición al pensamiento humano y el lenguaje, que se asume como original o auténtico. Dudo sobre la utilidad última (y precisión) de esta distinción y también sobre su aplicabilidad a las computadoras.” Brian Cantwell Smith, On the Origin of Objects. MIT Press, 1996, p. 10. Para una discusión extensa sobre el trabajo de Smith, ver Yuk Hui, “Digital Objects and Ontologies,” en On the Existence of Digital Objects. University of Minnesota Press, 2016 ↩︎

- Gotthard Günther, Das Bewusstsein der Maschinen: eine Metaphysik der Kybernetik (Agis-Verlag, 1957); Gilbert Simondon, Sur la philosophie. PUF, 2016, p. 180. ↩︎

- Citado en Tiernan Ray, “ChatGPT Is ‘Not Particularly Innovative,’ and ‘Nothing Revolutionary,’ Says Meta’s Chief AI Scientist,” ZDNET, 23 de enero, 2023 ↩︎

- Brian Cantwell Smith, The Promise of Artificial Intelligence: Reckoning and Judgment. MIT Press, 2019. Dedico más tiempo al argumento de Smith en el tercer capítulo de Art and Cosmotechnics. E-flux and University of Minnesota Press, 2021. ↩︎

- Hannah Arendt, The Human Condition. University of Chicago Press, 1998, p. 127 ↩︎

- Gregory Bateson, “The Cybernetics of ‘Self’: A Theory of Alcoholism”, en Steps to an Ecology of Mind. Jason Aronson, 1987 ↩︎

- Ver Yuk Hui, “Para un pensamiento planetario”, e-flux journal, nº. 114. Diciembre 2020 ↩︎

- Ver la cuestión del «mal» en F. W. J. Schelling, Philosophical Investigations into the Essence of Human Freedom. SUNY Press, 2006 ↩︎